Primero vio el anuncio en Facebook y luego en TikTok. Después de ver una y otra vez lo que parecía ser una oferta de Elon Musk para una oportunidad de inversión, Heidi Swan pensó que tenía que ser verdad.

“Se parecía mucho a Elon Musk, sonaba igual que Elon Musk y pensé que era él”, dijo Swan.

Se puso en contacto con la empresa que estaba detrás de la propuesta y abrió una cuenta por más de 10.000 dólares. La trabajadora sanitaria de 62 años pensó que estaba haciendo una inversión inteligente en criptomonedas de un empresario e inversor con miles de millones de dólares.

Pero Swan pronto descubriría que había sido estafada por una nueva ola de ladrones de alta tecnología que usaban inteligencia artificial para crear deepfakes.

Incluso ahora, al mirar los videos y saber que son falsos, Swan todavía piensa que parecen convincentes.

“Todavía se parecen a Elon Musk”, dijo. “Todavía suenan como Elon Musk”.

Las estafas deepfake van en aumento

A medida que la tecnología de inteligencia artificial evoluciona y se vuelve más accesible, este tipo de estafas se vuelven más comunes.

Según Deloitte , un grupo líder en investigación financiera, el contenido generado por IA contribuyó a más de $12 mil millones en pérdidas por fraude el año pasado y podría llegar a $40 mil millones en los EE. UU. en 2027.

Tanto la Comisión Federal de Comercio como el Better Business Bureau han emitido advertencias de que las estafas deepfake están en aumento.

Un estudio de la empresa de inteligencia artificial Sensity descubrió que Elon Musk es la celebridad más utilizada en las estafas de deepfake. Una de las posibles razones es su riqueza y su espíritu emprendedor. Otra razón es la cantidad de entrevistas que ha concedido: cuanto más contenido de alguien haya en línea, más fácil será crear deepfakes convincentes.

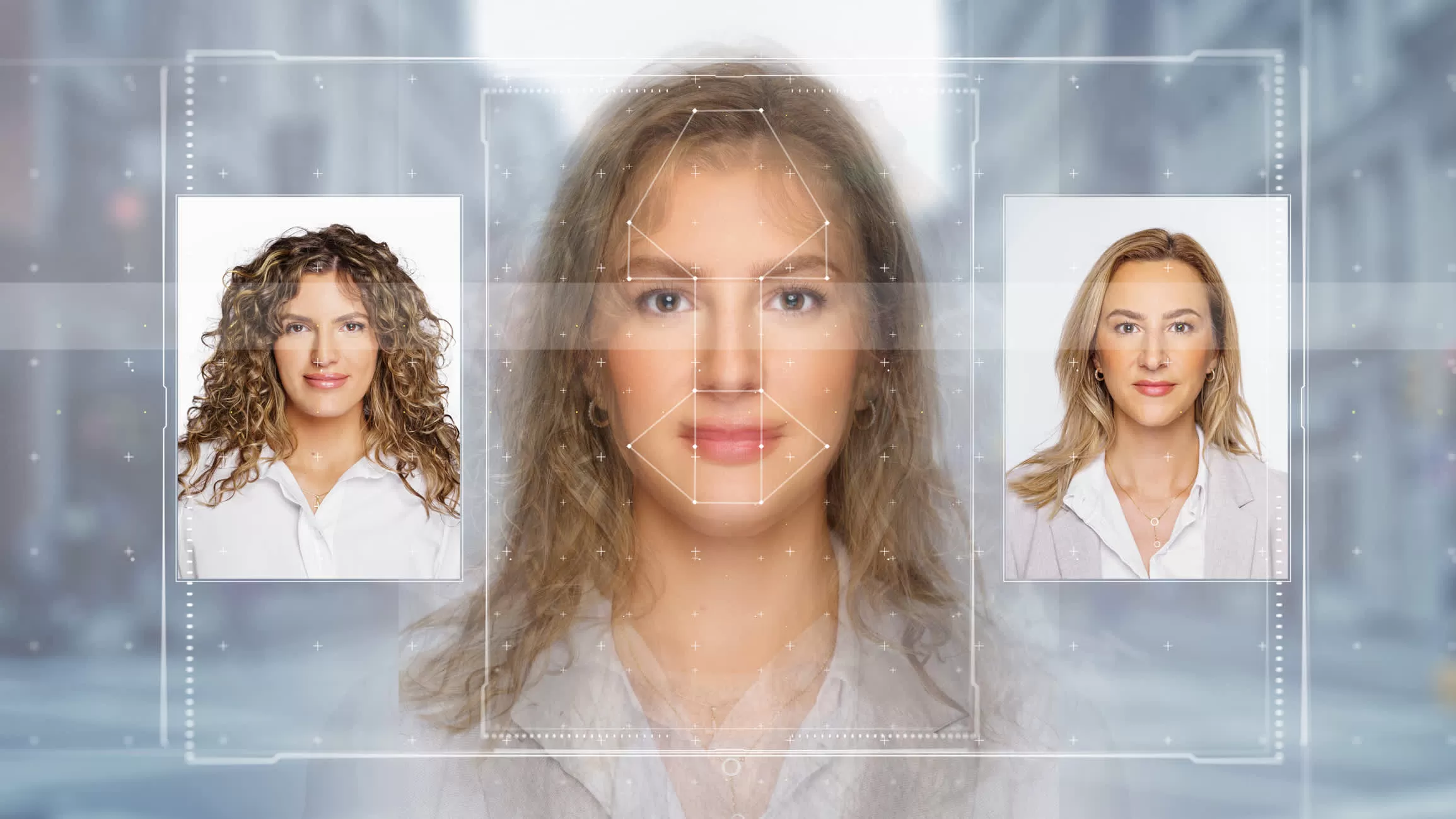

Anatomía de un deepfake

En la Universidad del Norte de Texas en Denton, el profesor Christopher Meerdo también utiliza inteligencia artificial, pero la utiliza para crear arte.

“No va a reemplazar a las artes creativas”, dijo Meerdo. “Simplemente las va a ampliar y va a cambiar la forma en que entendemos las cosas que podemos hacer en el ámbito de la creatividad”.

Aunque Meerdo ve la inteligencia artificial como una forma de ser innovador, ve sus peligros.

Meerdo mostró al I-Team cómo los estafadores pueden tomar un video real y usar herramientas de inteligencia artificial para reemplazar la voz y los movimientos de la boca de una persona, haciéndola parecer que dice algo completamente diferente.

Los avances tecnológicos están facilitando la creación de vídeos deepfake. Todo lo que necesita una persona familiarizada con la IA para crear uno es una única imagen fija y una grabación de vídeo.

Para demostrarlo, Meerdo tomó un video del periodista de investigación Brian New para crear un deepfake de Elon Musk.

Estos videos generados por IA no son perfectos, pero solo necesitan ser lo suficientemente convincentes para engañar a una víctima desprevenida.

“Si realmente estás tratando de estafar a la gente, creo que puedes hacer algunas cosas realmente malas con esto”, dijo Meerdo.

¿Cómo puedes detectar un deepfake?

Algunas falsificaciones profundas son más fáciles de detectar que otras; puede haber señales como movimientos de labios poco naturales o lenguaje corporal extraño. Pero a medida que la tecnología mejore, será más difícil detectarlas con solo mirarlas.

Cada vez hay más sitios web que afirman poder detectar deepfakes. El equipo de investigación utilizó tres vídeos deepfake conocidos y tres auténticos para someter a cinco de estos sitios web a una prueba no científica: Deepware, Attestiv , DeepFake-O-Meter , Sensity y Deepfake Detector.

En total, estas cinco herramientas en línea identificaron correctamente los videos evaluados casi el 75 % de las veces. El equipo de investigación se comunicó con las empresas para comunicarles los resultados; sus respuestas se encuentran a continuación.

Software profundo

Deepware, un sitio web de uso gratuito, no detectó en un principio dos de los vídeos falsos que el equipo de investigación analizó. En un correo electrónico, la empresa afirmó que los clips utilizados eran demasiado cortos y que, para obtener los mejores resultados, los vídeos subidos debían tener una duración de entre 30 segundos y un minuto. Deepware identificó correctamente todos los vídeos más largos. Según la empresa, su tasa de detección se considera buena para la industria, con un 70 %.

La sección de preguntas frecuentes del sitio web de Deepware afirma: “Los deepfakes aún no son un problema resuelto. Nuestros resultados indican la probabilidad de que un video específico sea un deepfake o no”.

Detector de deepfakes

Deepfake Detector, una herramienta que cobra 16,80 dólares al mes, identificó uno de los vídeos falsos como “un 97 % de voz natural”. La empresa, que se especializa en detectar voces generadas por IA, dijo en un correo electrónico que factores como el ruido de fondo o la música pueden afectar los resultados, pero tiene una tasa de precisión de aproximadamente el 92 %.

En respuesta a una pregunta sobre las pautas para los consumidores promedio, la empresa escribió: “Nuestra herramienta está diseñada para ser fácil de usar. Los consumidores promedio pueden cargar fácilmente un archivo de audio en nuestro sitio web o usar nuestra extensión del navegador para analizar el contenido directamente. La herramienta proporcionará un análisis para ayudar a determinar si un video puede contener elementos deepfake utilizando probabilidades, lo que la hace accesible incluso para aquellos que no están familiarizados con la tecnología de inteligencia artificial”.

Certificado

Attestiv marcó dos de los videos reales como “sospechosos”. Según el director ejecutivo de la empresa, Nicos Vekiarides, los falsos positivos pueden ser provocados por factores como los gráficos y las ediciones. Ambos videos auténticos marcados como “sospechosos” incluían gráficos y ediciones. El sitio ofrece un servicio gratuito, pero también tiene un nivel de pago, donde los consumidores pueden ajustar la configuración y las calibraciones para un análisis más profundo.

Si bien reconoce que Attestiv no es perfecto, Vekiarides dijo que, a medida que los deepfakes se vuelven más difíciles de detectar a simple vista, este tipo de sitios web son necesarios como parte de la solución.

“Nuestra herramienta puede determinar si algo es sospechoso y luego puedes verificarlo con tus propios ojos y decir: ‘Creo que eso es sospechoso’”, dijo Vekiarides.

Medidor de deepfakes

DeepFake-O-Meter es otra herramienta gratuita respaldada por la Universidad de Buffalo y la Fundación Nacional de Ciencias. Identificó que dos de los videos reales tenían un alto porcentaje de haber sido generados por IA.

En un correo electrónico, el creador de la plataforma abierta dijo que una limitación de los modelos de detección de deepfake es que la compresión de video puede generar problemas de sincronización con el video y el audio y movimientos de boca inconsistentes.

En respuesta a una pregunta sobre cómo los usuarios cotidianos pueden utilizar la herramienta, la empresa envió un correo electrónico: “Actualmente, el resultado principal que se muestra a los usuarios es el valor de probabilidad de que esta muestra sea una muestra generada a través de diferentes modelos de detección. Esto se puede utilizar como referencia si varios modelos coinciden en la misma respuesta con confianza (por ejemplo, más del 80 % para los generados por IA o menos del 20 % para los videos reales). Actualmente estamos desarrollando una forma más comprensible de mostrar los resultados, así como nuevos modelos que puedan generar resultados de detección completos”.

Sensibilidad

El detector de deepfakes de Sensity identificó correctamente los seis clips y mostró un mapa de calor que indica dónde es más probable que haya manipulación de IA.

La compañía ofrece un período de prueba gratuito para utilizar su servicio y le dijo al I-Team que, si bien actualmente está diseñado para organizaciones privadas y públicas, su objetivo futuro es hacer que la tecnología sea accesible para todos.